2月13日晚,MiniMax正式开源了最新旗舰模型M2.5。壁仞科技(06082.HK)旗舰产品壁砺™166系列率先完成M2.5的本地化部署,成为首批完成适配的国产算力厂商。

M2.5在BR166服务器上基于vLLM壁仞平台插件完成推理补全任务

近日,国产大模型生态迎来密集重磅升级。依托壁砺™166系列产品的高通用性与全自研BIRENSUPA™软件栈的成熟度,壁仞科技此前已极速完成对GLM-5、Step 3.5 Flash等多款SOTA顶级大模型的适配支持,大幅降低开发者的模型部署与应用门槛,有力推动Agent智能体技术的商业化落地与规模化拓展。

对SOTA模型的极速适配,进一步验证了vLLM壁仞科技平台插件的成熟度。通过深度集成BIRENSUPA™高性能算子库,壁仞科技可针对混合专家模型及核心注意力机制实现指令级深度优化,充分释放壁砺系列产品算力潜能,打造兼具性能与成本优势的极致推理方案。

此外,面向大型MoE模型稀疏激活、DSA稀疏注意力、MTP多Token预测等关键特性,以及超长文本的实际应用需求,壁砺™166系列产品与BIRENSUPA™软件栈实现前瞻性协同设计。产品充分发挥Cwarp、TDA等自研架构优势,深度打磨高性能算子与推理框架,真正实现对该类复杂模型的即刻适配。

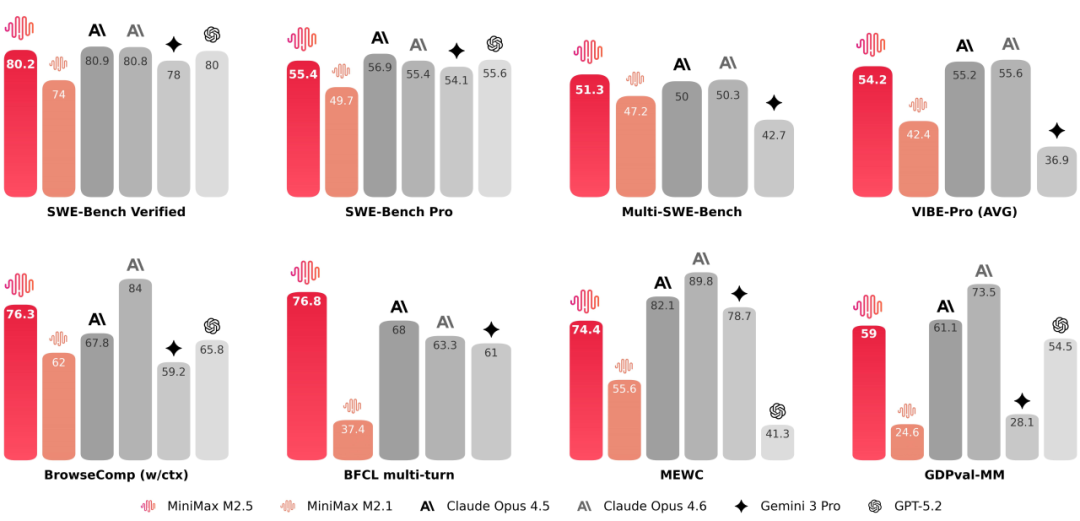

关于MiniMax M2.5

作为定位“原生Agent(智能体)生产级模型”的产品,MiniMax M2.5在编程、工具调用和搜索、办公等生产力场景都达到或者刷新了行业的SOTA,比如 SWE-Bench Verified(80.2%),Multi-SWE-Bench(51.3%),BrowseComp(76.3%)。

MiniMax M2.5在Agentic Engineering benchmark中取得多项SOTA成绩

M2.5优化了模型对复杂任务的拆解能力和思考过程中token的消耗,使其能更快地完成复杂的Agentic任务,比如在SWE-Bench Verified的测试中,比上一个版本M2.1完成任务的速度快了37%。

M2.5是第一个不需要考虑使用成本可以无限使用的前沿模型。在每秒输出100个token的情况下,M2.5连续工作一小时只需花费1美金;而在每秒输出50个token的情况下,只需要0.3美金。

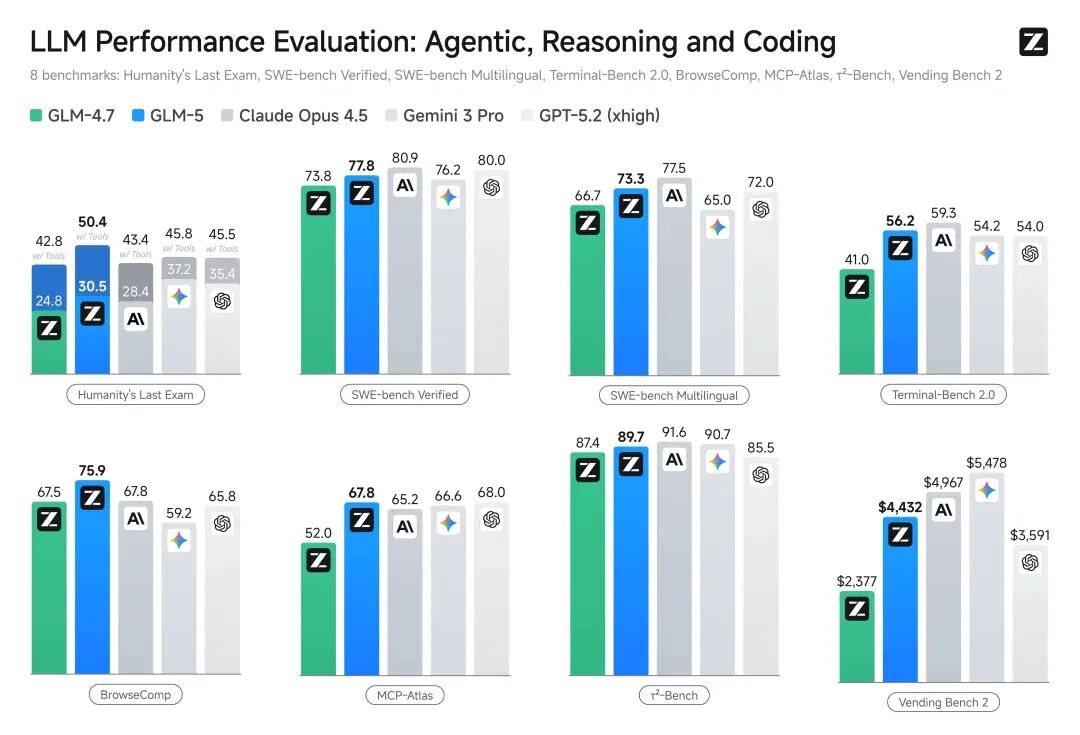

关于GLM-5

GLM-5是智谱新一代的旗舰基座模型,面向Agentic Engineering打造,能够在复杂系统工程与长程Agent任务中提供可靠生产力。在Coding与Agent能力上,GLM-5取得开源SOTA表现,在真实编程场景的使用体感逼近Claude Opus 4.5,擅长复杂系统工程与长程Agent任务,是通用Agent助手的理想基座。GLM-5模型参数规模达到744B(其中激活40B),采用28.5T数据预训练,并集成DeepSeek Sparse Attention,在部署成本和效率上进一步提升。

GLM-5在BR166服务器上基于vLLM壁仞平台插件完成推理补全任务

壁仞科技此前已经完成对MiniMax M2.1、智谱GLM-4.7等系列旗舰大模型的适配,并持续深度优化,在模型精度和稳定性方面表现优异,充分验证了壁砺™系列产品对国产SOTA大模型的卓越适配性。未来,壁仞科技将持续加强对包括MiniMax、智谱、阶跃星辰在内的国产大模型厂商的生态适配支持,并与生态伙伴在高级智能体、项目级编程等Agentic Engineering领域共同打造“国模国芯”解决方案和示范性业务场景,助力中国AI产业向世界最先进水平持续迈进。